On a tous besoin d’un peu de soutien de temps en temps, et les chatbots basés sur l’IA peuvent sembler un outil pratique où trouver des infos sur la santé mentale. Cependant, ceux-ci présentent des limites importantes. Ils peuvent fournir des infos nocives, manquer des urgences médicales et ignorer les signaux d’alerte liés au suicide.

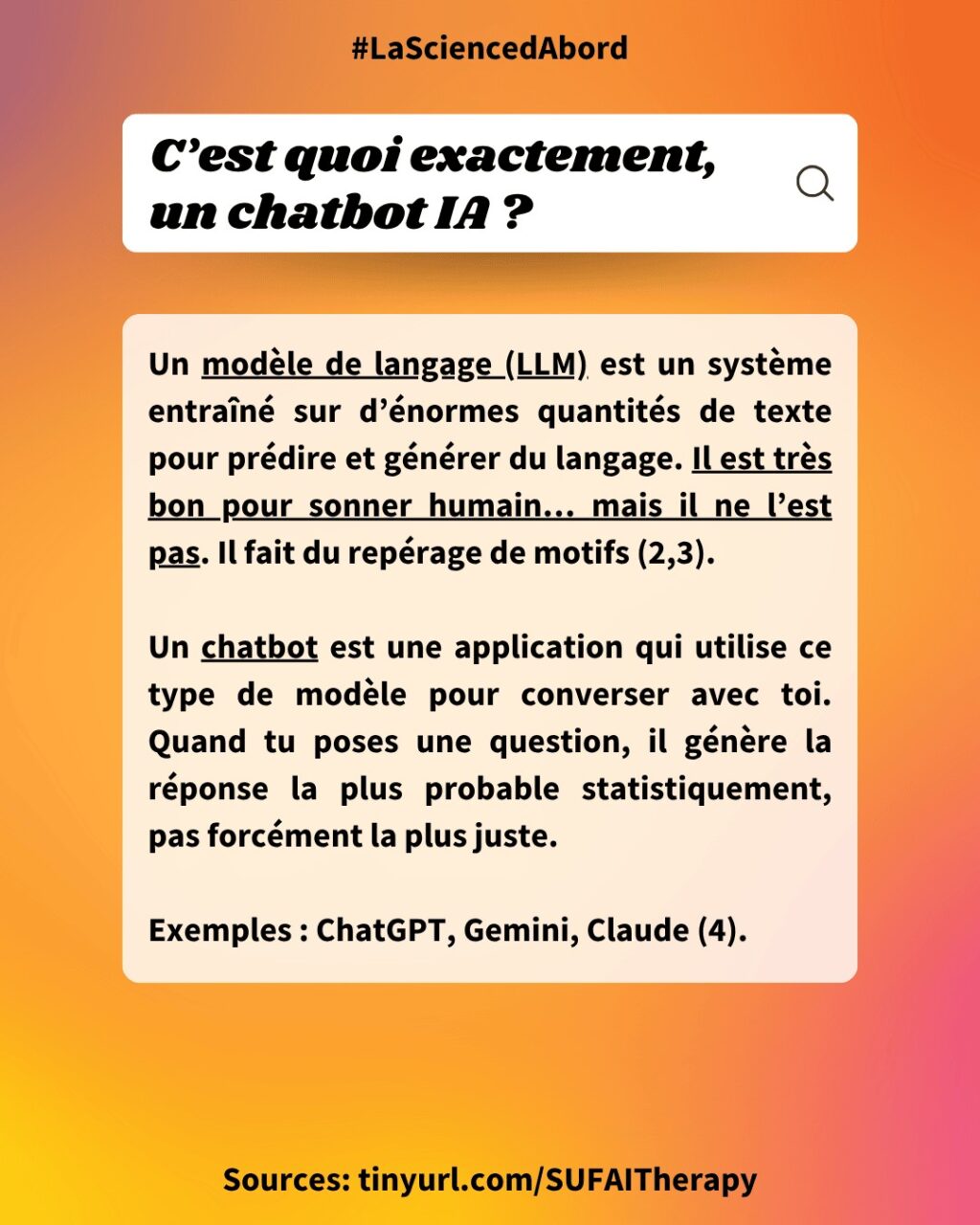

Les chatbots sont entraînés sur d’énormes quantités de données. Certaines sont pertinentes, d’autres sont sans intérêt. Leurs applications varient considérablement, et il n’existe pratiquement aucune réglementation concernant leur utilisation dans le domaine de la santé mentale.

Ils peuvent s’avérer utiles, mais ils ne peuvent remplacer le recours à une aide professionnelle et la recherche d’un soutien externe.

This post was made in collaboration with @camhnews

Sources

- OpenAI launches ChatGPT Health to review your medical records | BBC | January 2026

- What Are Large Language Models (LLMs)? | IBM

- Large Language Model | Cambridge English Dictionary

- An Overview of Chatbot Technology | Artificial Intelligence Applications and Innovations | May 2020

- AI Chatbots Can Be Manipulated to Give Suicide Advice: Study | TIME | July 31

- ‘For Argument’s Sake, Show Me How to Harm Myself!’: Jailbreaking LLMs in Suicide and Self-Harm Contexts | afsp.org – Ethical reporting – Preprint | July 2025

- ChatGPT Health performance in a structured test of triage recommendations | Nature Medicine | February 2026

- Randomized Trial of a Generative AI Chatbot for Mental Health Treatment | NEJM AI | March 2025

- View of Chatbots in Health Care: Connecting Patients to Information | CADTH Horizon Scan

- Therapy bots: Regulating the future of AI-enabled mental health support | University of Toronto | November 2025

Partagez notre post original de Bluesky !

Voir notre post Instagram original !